Wie ein Industrieroboter zum Star der Bühne wurde

„ETERNAL DAWN“: Eine Musiktheaterproduktion des Komponisten und Multimedia-Künstlers Alexander Schubert (HfMT Hamburg) bot Anlass für eine außergewöhnliche Zusammenarbeit mit dem Haptic Lab des ligeti zentrums. Die Ingenieure Dr.-Ing. Mohammad Sadeghi, Kyrillos Adeeb und Inderawes Khalil der Technischen Universität Hamburg (TUHH) transformierten einen industriellen UR10-Roboter, der – kopfüber von der Bühnendecke hängend – zum aktiven Bühnenpartner wurde. Ein Gespräch über das faszinierende Zusammenspiel von Mechanik, Licht und Bewegung.

ligeti zentrum: Ein Roboter, der an der Decke hängt – das ist ein ungewöhnlicher Anblick. Was sehen wir hier genau?

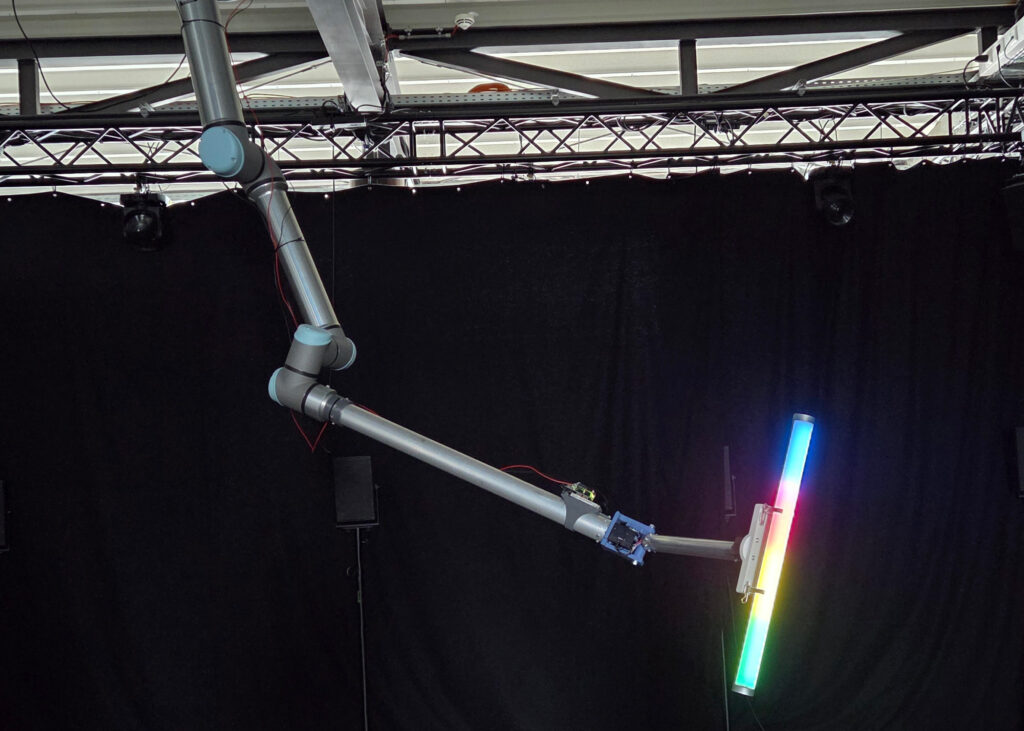

Haptic Lab: Das ist ein UR10-Industrieroboter, den wir für künstlerische Performances in Zusammenarbeit mit der Hochschule für Musik und Theater Hamburg einsetzen. In einer früheren Produktion der Berliner Philharmoniker befestigten wir bereits eine Leuchtröhre an einem Roboterarm, der die Körper der Performer:innen „abscannte“. Das Sci-Fi-Konzept des Stücks „Terminal Infinity“ stellte dar, wie menschliches Bewusstsein hochgeladen und künstliches Bewusstsein heruntergeladen wird.

Auch in der Musiktheaterinstalltion „ETERNAL DAWN“ sollte wieder ein Roboter mitspielen. Das Konzept entwickelten wir im ligeti zentrum weiter. Die Idee: Statt einer klassischen Befestigung auf dem Boden oder auf einem Tisch sollte der Roboter kopfüber von der Bühnendecke hängen. Ein solches Setup ist einzigartig – wir haben so etwas noch nie zuvor gesehen. Im Haptic Lab und im Production Lab fand die Vorbereitung, Entwicklung und Testphase statt.

Dieses Setup ist einzigartig – wir haben so etwas noch nie gesehen

Einen Industrieroboter bühnentauglich machen

ligeti zentrum: Welche technischen Herausforderungen gingen mit dem Umbau und der Neuprogrammierung des Roboters einher?

Haptic Lab: Die Bühne des Straßburger Theaters Le Maillon, auf der das Stück im September 2025 Premiere feierte, ist mit rund zehn Metern Höhe und zwanzig Metern Breite besonders groß und offen. Wir mussten also zunächst einmal sicherstellen, dass das Publikum den Roboterarm gut sehen könnte. Ein herkömmlicher UR10-Roboter war für unsere Bedürfnisse zu klein. Wir brauchten einen Arm, der länger und trotzdem beweglich und präzise steuerbar wäre. Außerdem musste er stärker sein. Die Motoren von Industrierobotern haben strenge Sicherheitsgrenzen. Sie können also nur begrenzte Lasten tragen.

Im voll ausgefahrenen Zustand erreicht der Roboterarm jetzt eine Länge von 3,3 Metern. Wie auch bei „Terminal Infinity“ ist am Ende eine Lichtstange montiert. Das Gewicht und die Hebelkräfte sind bei dieser Größe enorm. Die Physik dahinter kann man anhand des menschlichen Körpers gut verdeutlichen: Je weiter man seinen Arm ausstreckt, umso schwerer wird das Heben von Gegenständen. Dieses physikalische Problem mussten wir lösen.

Da der Roboter direkt über den Performer:innen zum Einsatz kommt und mit diesen interagiert, waren auch die nötigen Sicherheitsmaßnahmen enorm.

Wir mussten die Systeme nicht nur technisch funktionsfähig, sondern vor allem auch sicher konzipieren

ligeti zentrum: Welche Überlegungen und Sicherheitsmaßnahmen waren nötig, um die besondere Mensch-Maschine-Interaktion in „ETERNAL DAWN“ zu ermöglichen?

Haptic Lab: Sicherheit stand für uns an erster Stelle. Wir haben alle Mechanismen mehrfach abgesichert – mit verstärkten Gelenken, Überlastschutz und unabhängigen Notfallsystemen. Da wir die Systeme selbst konstruiert haben, wurden sie neben zahlreichen internen Tests auch von einem externen Sicherheitsexperten im August 2025 geprüft und nach DGUV V17 (BGV C1) zertifiziert.

Roboter und Systeme, die direkt über Menschen zum Einsatz kommen, fallen generell unter die höchste Sicherheitsklasse. Das machte die Konzeption besonders herausfordernd: Wir mussten die Systeme nicht nur technisch funktionsfähig, sondern vor allem sicher konzipieren.

ligeti zentrum: Hat das Team zuvor schon einmal mit solch strengen Normen gearbeitet?

Haptic Lab: Nein, das war vollkommen neu für uns. Normalerweise sind UR10-Roboter in Industriehallen und Fabriken im Einsatz – nicht auf einer Bühne. Wir verbinden Industrie-, Steuerungs- und Bühnentechnik in einer Live-Umgebung. Damit betreten wir buchstäblich Neuland – und schaffen vielleicht einen neuen Standard.

Der Entwicklungsprozess war ein ständiges Wechselspiel zwischen digitalem Modell und realer Erprobung

ligeti zentrum: Wie begegnet man einem solch komplexen Projekt? Wo fängt man an?

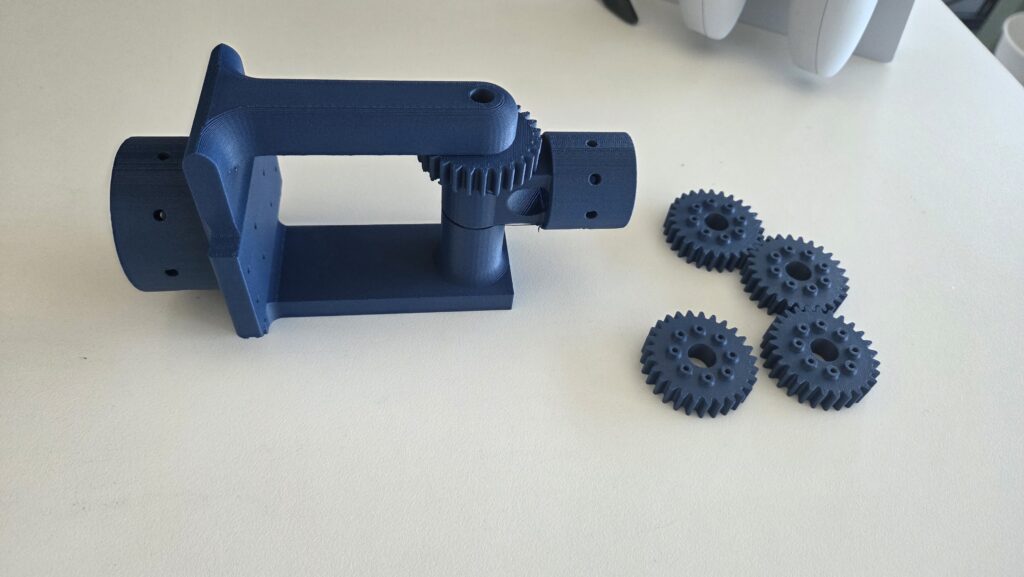

Haptic Lab: Zunächst einmal modellierten wir das gesamte System im CAD-Programm SolidWorks. Hier simulierten wir Lasten und Drehmomente. Dabei zeigte sich schnell: Ein Motor alleine würde nicht ausreichen. Also koppelten wir zwei Motoren pro Gelenk, das wir entsprechend konzipierten und mit dem 3D-Drucker herstellten. Als die digitalen Simulationen an ihre Grenzen stießen, wechselten wir zu physischen Tests. Der Entwicklungsprozess war ein ständiges Wechselspiel zwischen digitalem Modell und realer Erprobung.

Wenn die Verbindung abbricht, ist die Show vorbei

ligeti zentrum: Wie viel wiegt der Roboter insgesamt?

Haptic Lab: Etwa 35 Kilogramm. Das liegt nicht zuletzt auch an der Verkabelung. Für eine Bühne in der Größenordnung des Maillon in Straßburg benötigten wir rund 30 bis 40 Meter Kabel.

Die Verbindung zum Roboter muss die ganze Zeit stabil sein. Wenn die Verbindung abbricht, ist die Show vorbei.

Wenn Mensch und Maschine interagieren

ligeti zentrum: „ETERNAL DAWN“ spielt in einem Labor, in dem die Darsteller:innen als Cyborgs agieren. Unterstützt werden sie durch technische Körpererweiterungen, Bio-Modifikationen und Sensoren. Wie muss man sich die Interaktionen zwischen dem Roboter und den Performer:innen vorstellen?

Haptic Lab: Die Show schafft mehrere sehr intensive Begegnungen zwischen Mensch und Maschine. In einer Szene liegt ein Tänzer auf einem hydraulischen Tisch. Während sich der Tisch samt Performer von unten hebt, nähert sich der Roboterarm von oben. In voll ausgestrecktem Zustand beginnt der Roboter schließlich, wie ein Pendel hin und her zu schwingen. Den Tänzer verfehlt er mit jedem Schwung um wenige Zentimeter – die Choreografie ist perfekt aufeinander abgestimmt.

ligeti zentrum: Wird der Roboter in solchen Szenen manuell gesteuert?

Haptic Lab: Nein, während der Performance läuft alles vollautomatisch, aber wir überwachen das System natürlich permanent.

Unser Trainingssystem bildet acht Regler ab, die mit den Gelenken des Roboters korrelieren. Im Rahmen der Programmierung speicherten wir etliche individuelle Positionen ab, bevor die Software sie zu fließenden Bewegungen zusammenfügen konnte.

Während der Show werden diese Sequenzen über OSC-Signale ausgelöst. Das ist dasselbe Protokoll, das Künstler:innen für die Licht- und Soundsteuerung nutzen. So entstehen exakt getaktete, choreografierte Bewegungen, die minutiös mit den Performer:innen abgestimmt wurden.

ligeti zentrum: Für die Bühnenperformance werden also verschiedene technische Systeme kombiniert?

Haptic Lab: Genau. Der Roboter und der Steuerchip laufen über getrennte Systeme – mit eigenen Stromkreisen und Kommunikationsprotokollen. Wir mussten eine eigene Software entwickeln, um beide zu synchronisieren. Die Steuerbox des Roboters übernimmt die Bewegungen. Ein einziges Kabel überträgt derweil Strom und Signal – das vereinfacht vieles.

ligeti zentrum: Neben der Funktion spielt sicher auch das Design eine Rolle.

Haptic Lab: Absolut. Wir haben die Aluminiumrohre und Gelenke so gestaltet, dass sie sich optisch ins Bühnenbild einfügen. Alle sichtbaren Kabel, die während unserer Tests im Production Lab schnell zugänglich sein mussten, wurden zur Aufführung verbaut und verdeckt.

Die Befestigung des Roboters an der Decke machte die Umsetzung auch in dieser Hinsicht herausfordernd. Wir mussten Funktionalität und Ästhetik miteinander in Einklang bringen – aber das ist uns gelungen.

ligeti zentrum: Der Roboter nimmt in der Show eine zentrale Rolle ein. Zugleich sind auf der Bühne aber auch bewegliche Lichtrahmen zu sehen. Was hat es damit auf sich?

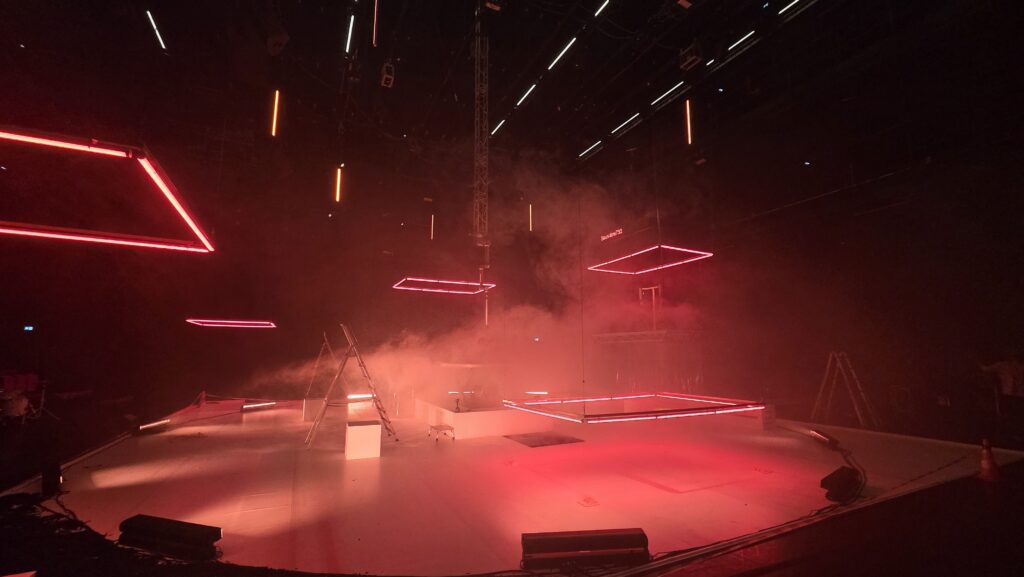

Haptic Lab: Dieses Projekt nennen wir „Motor Matrix“. Hier bewegen 16 Aktuatoren Titan-Lichtrahmen, die jeweils etwa zwei mal drei Meter groß sind. Vier Motoren steuern jeden Rahmen über Seile, sodass diese sich durch Kippen, Heben, Senken und Rotieren in verschiedene Richtungen bewegen lassen.

Genau wie der Roboter bewegen sich auch die Lichtrahmen direkt über den Darsteller:innen. Auch sie verfügen dementsprechend über mehrere extern geprüfte Sicherheitsstufen: Not-Aus-Schalter und Endschalter, die über ein Siemens-PLC-System gesteuert werden.

ligeti zentrum: Wie fühlt es sich an, den Industrieroboter und die „Motor Matrix“ am Ende auf der großen Bühne zu sehen?

Haptic Lab: Es ist absolut faszinierend! Als Ingenieur:innen vertreten wir eine technische Perspektive. Die mussten wir in diesem Projekt mit einer künstlerischen Denkweise kombinieren.

Künstler:innen denken in Bewegungen, Bildern und Emotionen – nicht alles aber ist technisch umsetzbar. Diese beiden Welten zu verbinden und den vorgegebenen Zeitplan, das Budget und die physikalischen Begebenheiten in Einklang zu bringen, war ein wesentlicher Teil unserer Arbeit.

Zu sehen, wie am Ende alles zusammenkommt und dass alles funktioniert, wie wir es uns gedacht haben, ist einfach großartig.

Den Roboter live in Action erleben

„ETERNAL DAWN“ feierte am 19. September 2025 in Straßburg (Frankreich) Premiere. Jetzt kommt die Show auch nach Hamburg! „ETERNAL DAWN“ ist vom 15. bis 17. Januar 2026 auf Kampnagel in Hamburg zu sehen.

Das installative Musiktheater ist in Auftrag der Kulturstiftung des Bundes entstanden. Die internationale Kooperation umfasst Alexander Schubert, das Decoder Ensemble, professionelle Tänzer:innen und Darsteller:innen, das GRAME Centre National de Création Musicale, das ligeti zentrum und das Institut für Mechatronik im Maschinenbau (IMEK) der TUHH.

Eine Preview gibt es zudem beim Tag der offenen Tür des ligeti zentrums am 22. November 2025: Die „Motor Matrix“ wird von 13 bis 16 Uhr im Rahmen einer 3D-Audio Listening Session im Production Lab präsentiert.